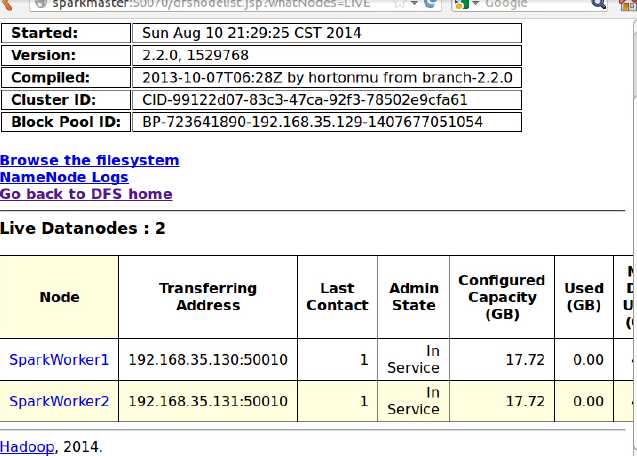

从控制台我们可以看见有两个DataNode,此时我们点击“Live Nodes”查看一下其信息:

从控制台中看到了我们的两个Datanode节点SparkWorker1和SparkWorker2,这正是我们预期中的!

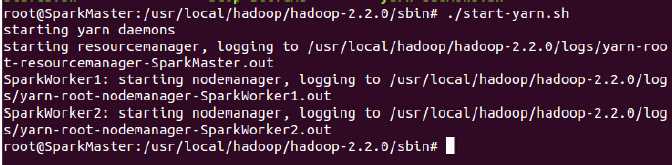

第三步:启动yarn集群

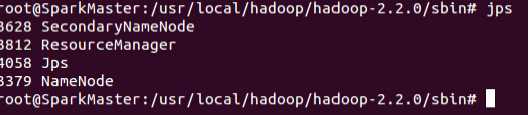

使用jps命令可以发现SparkMaster机器上启动了ResourceManager进程:

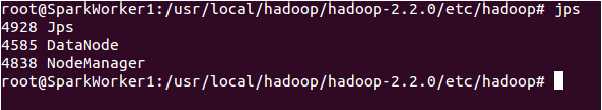

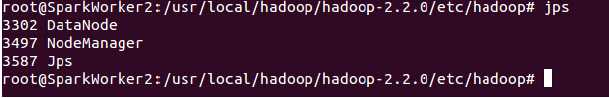

而在SparkWorker1和SparkWorker2上则分别启动了NodeManager进程:

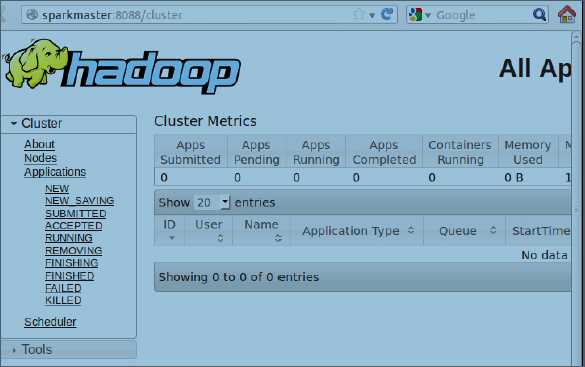

在SparkMaster上访问http://SparkMaster:8088 可以通过Web控制台查看ResourceManager运行状态:

在SparkMaster上访问http://SparkWorker1:8042 可以通过Web控制台查看SparkWorker1上的NodeManager运行状态:

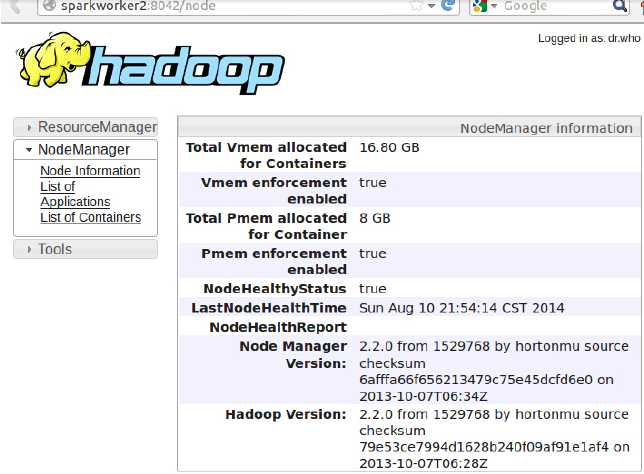

在SparkMaster上访问http://SparkWorker2:8042 可以通过Web控制台查看SparkWorker2上的NodeManager运行状态:

接下来使用“mr-jobhistory-daemon.sh”来启动JobHistory Server:

启动后可以通过http://SparkMaster:19888 在Web控制台上看到JobHistory中的任务执行历史信息:

【Spark亚太研究院系列丛书】Spark实战高手之路-第一章 构建Spark集群(第五步)(5)

原文:http://www.cnblogs.com/spark-china/p/4039511.html