https://blog.csdn.net/ai_lx/article/details/88953587

import tensorflow as tf

a = tf.constant([-1.0, 12.0])

with tf.Session() as sess:

b = tf.nn.softplus(a)

print(sess.run(b))

#输出

[ 0.31326166 12.000006 ]

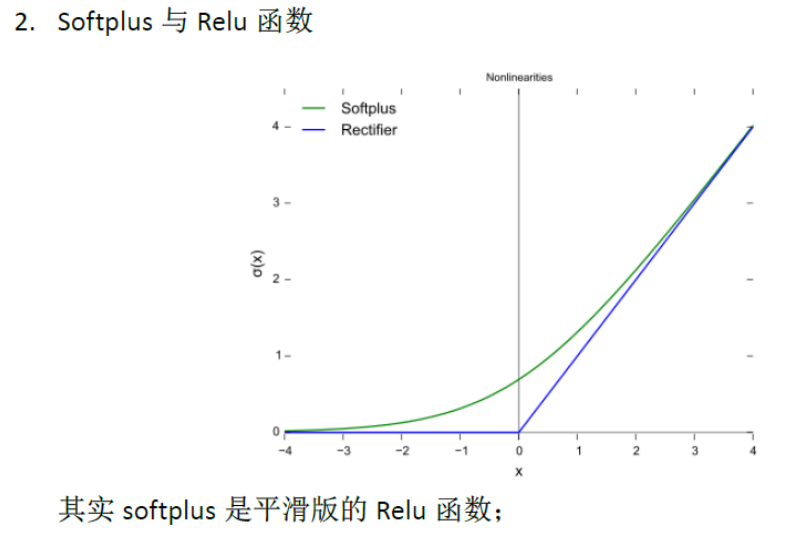

就是soft plus。#不是softmax,不是归一化。

公式是:log( exp( features ) + 1),所输入的a就是features。

https://blog.csdn.net/bqw18744018044/article/details/81193241

![]()

原文:https://www.cnblogs.com/BlueBlueSea/p/14324671.html