在数仓中,建议大家除了接口表(从其他数据库导入或者是最后要导出到其他数据库的表),其余表的存储格式与压缩格式保持一致。

我们先来说一下目前Hive表主流的存储格式与压缩方式。

从Hive官网得知,Apache Hive支持Apache Hadoop中使用的几种熟悉的文件格式,如 TextFile(文本格式),RCFile(行列式文件),SequenceFile(二进制序列化文件),AVRO,ORC(优化的行列式文件)和Parquet 格式,而这其中我们目前使用最多的是TextFile,SequenceFile,ORC和Parquet。

下面来详细了解下这2种行列式存储。

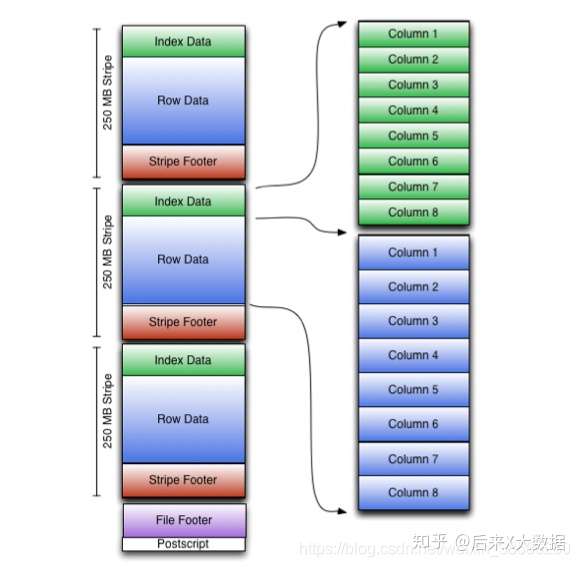

我们先从官网上拿到ORC的存储模型图

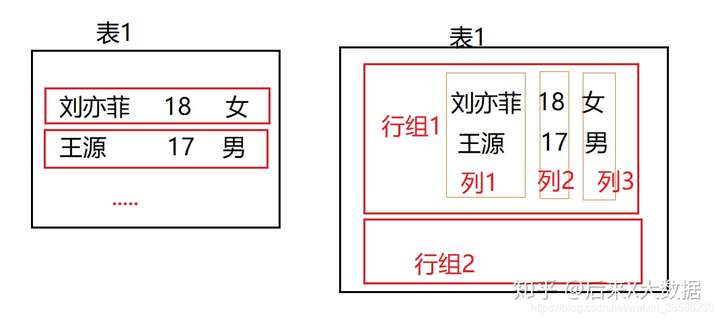

看起来略微有点复杂,那我们稍微简化一下,我画了一个简单的图来说明一下

左边的图就表示了传统的行式数据库存储方式,按行存储,如果没有存储索引的话,如果需要查询一个字段,就需要把整行的数据都查出来然后做筛选,这么做式比较消耗IO资源的,于是在Hive种最开始也是用了索引的方式来解决这个问题。

但是由于索引的高成本,在「目前的Hive3.X 中,已经废除了索引」,当然也早就引入了列式存储。

列式存储的存储方式,其实和名字一样,它是按照一列一列存储的,如上图中的右图,这样的话如果查询一个字段的数据,就等于是索引查询,效率高。但是如果需要查全表,它因为需要分别取所有的列最后汇总,反而更占用资源。于是ORC行列式存储出现了。

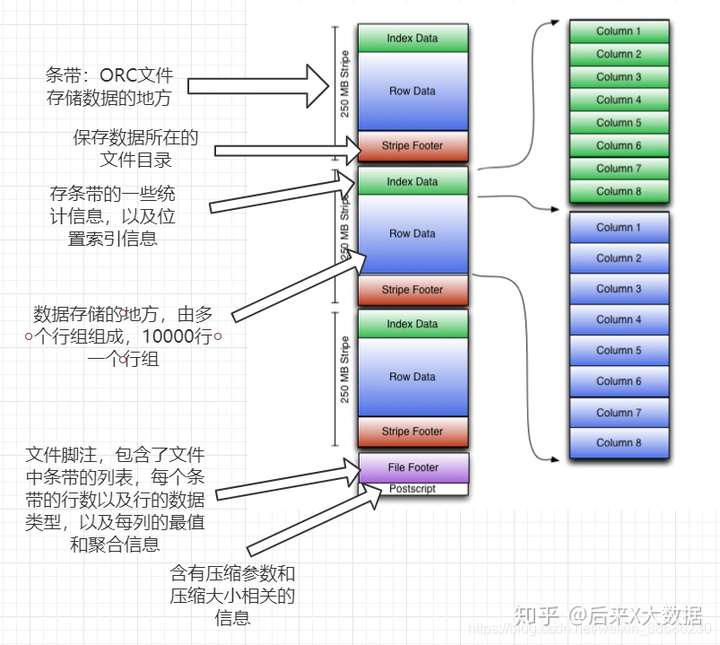

了解了ORC存储的基本逻辑后,我们再来看看它的存储模型图。

同时我也把详细的文字也附在下面,大家可以对照着看看:

index data:保存了所在条带的一些统计信息,以及数据在 stripe中的位置索引信息。

rows data:数据存储的地方,由多个行组构成,每10000行构成一个行组,数据以流( stream)的形式进行存储。

stripe footer:保存数据所在的文件目录

所以其实发现,ORC提供了3级索引,文件级、条带级、行组级,所以在查询的时候,利用这些索引可以规避大部分不满足查询条件的文件和数据块。

但注意,ORC中所有数据的描述信息都是和存储的数据放在一起的,并没有借助外部的数据库。

「特别注意:ORC格式的表还支持事务ACID,但是支持事务的表必须为分桶表,所以适用于更新大批量的数据,不建议用事务频繁的更新小批量的数据」

#开启并发支持,支持插入、删除和更新的事务

set hive. support concurrency=truei

#支持ACID事务的表必须为分桶表

set hive. enforce bucketing=truei

#开启事物需要开启动态分区非严格模式

set hive.exec,dynamicpartition.mode-nonstrict

#设置事务所管理类型为 org. apache.hive.q1. lockage. DbTxnManager

#原有的org. apache. hadoop.hive.q1.1 eckmar. DummyTxnManager不支持事务

set hive. txn. manager=org. apache. hadoop. hive. q1. lockmgr DbTxnManageri

#开启在相同的一个 meatore实例运行初始化和清理的线程

set hive. compactor initiator on=true:

#设置每个 metastore实例运行的线程数 hadoop

set hive. compactor. worker threads=l

#(2)创建表

create table student_txn

(id int,

name string

)

#必须支持分桶

clustered by (id) into 2 buckets

#在表属性中添加支持事务

stored as orc

TBLPROPERTIES(‘transactional‘=‘true‘);

#(3)插入数据

#插入id为1001,名字为student 1001

insert into table student_txn values(‘1001‘,‘student 1001‘);

#(4)更新数据

#更新数据

update student_txn set name= ‘student 1zh‘ where id=‘1001‘;

# (5)查看表的数据,最终会发现id为1001被改为 sutdent_1zh

表配置属性(建表时配置,例如tblproperties (‘orc.compress‘=‘snappy‘);:

上面说过ORC后,我们对行列式存储也有了基本的了解,而Parquet是另一种高性能的行列式存储结构。

既然ORC都那么高效了,那为什么还要再来一个Parquet,那是因为「Parquet是为了使Hadoop生态系统中的任何项目都可以使用压缩的,高效的列式数据表示形式」

? Parquet 是语言无关的,而且不与任何一种数据处理框架绑定在一起,适配多种语言和组件,能够与 Parquet 配合的组件有:

查询引擎: Hive, Impala, Pig, Presto, Drill, Tajo, HAWQ, IBM Big SQL

计算框架: MapReduce, Spark, Cascading, Crunch, Scalding, Kite

数据模型: Avro, Thrift, Protocol Buffers, POJOs

?

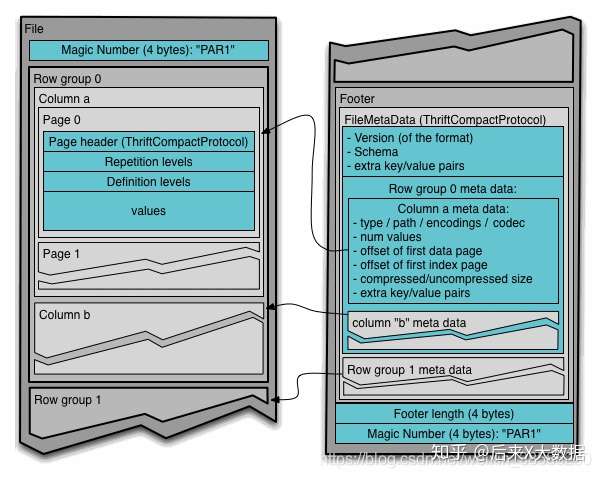

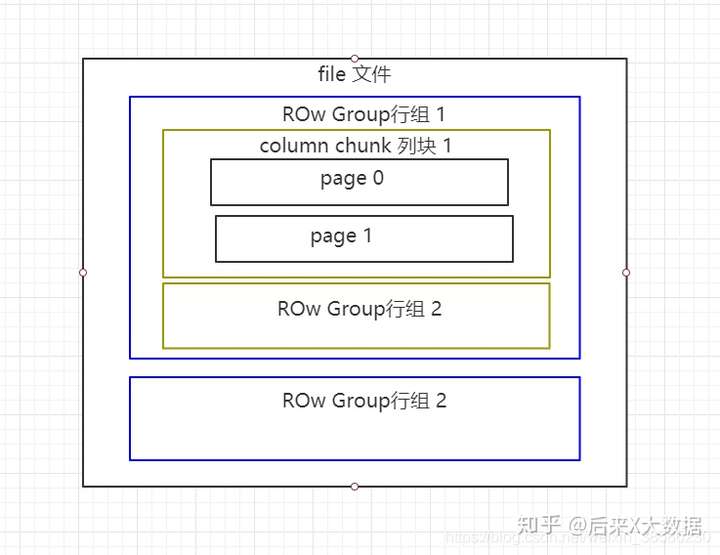

再来看看Parquet的存储结构吧,先看官网给的

嗯,略微有点头大,我画个简易版

Parquet文件是以二进制方式存储的,所以不可以直接读取,和ORC一样,文件的元数据和数据一起存储,所以Parquet格式文件是自解析的。

同时,从《Hive性能调优实战》作者的案例中,2张分别采用ORC和Parquet存储格式的表,导入同样的数据,进行sql查询,「发现使用ORC读取的行远小于Parquet」,所以使用ORC作为存储,可以借助元数据过滤掉更多不需要的数据,查询时需要的集群资源比Parquet更少。(查看更详细的性能分析,请移步https://blog.csdn.net/yu616568/article/details/51188479)

「所以ORC在存储方面看起来还是更胜一筹」

ble data-draft-node="block" data-draft-type="table" data-size="normal" data-row-style="normal">

根据ORC和parquet的要求,一般就有了

create table stu_orc(id int,name string)

stored as orc

tblproperties (‘orc.compress‘=‘snappy‘);

create table stu_par(id int,name string)

stored as parquet

tblproperties (‘parquet.compression‘=‘lzo‘);

create table stu_par(id int,name string)

stored as parquet

tblproperties (‘parquet.compression‘=‘snappy‘);

因为Hive 的SQL会转化为MR任务,如果该文件是用ORC存储,Snappy压缩的,因为Snappy不支持文件分割操作,所以压缩文件「只会被一个任务所读取」,如果该压缩文件很大,那么处理该文件的Map需要花费的时间会远多于读取普通文件的Map时间,这就是常说的「Map读取文件的数据倾斜」。

那么为了避免这种情况的发生,就需要在数据压缩的时候采用bzip2和Zip等支持文件分割的压缩算法。但恰恰ORC不支持刚说到的这些压缩方式,所以这也就成为了大家在可能遇到大文件的情况下不选择ORC的原因,避免数据倾斜。

在Hve on Spark的方式中,也是一样的,Spark作为分布式架构,通常会尝试从多个不同机器上一起读入数据。要实现这种情况,每个工作节点都必须能够找到一条新记录的开端,也就需要该文件可以进行分割,但是有些不可以分割的压缩格式的文件,必须要单个节点来读入所有数据,这就很容易产生性能瓶颈。(下一篇文章详细写Spark读取文件的源码分析)

「所以在实际生产中,使用Parquet存储,lzo压缩的方式更为常见,这种情况下可以避免由于读取不可分割大文件引发的数据倾斜。 但是,如果数据量并不大(预测不会有超大文件,若干G以上)的情况下,使用ORC存储,snappy压缩的效率还是非常高的。」

Hive数仓建表该选用ORC还是Parquet,压缩选LZO还是Snappy?

原文:https://www.cnblogs.com/coco2015/p/13920033.html