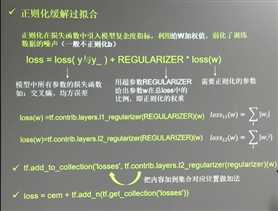

1、正则化缓解过拟合

正则化在损失函数中引入模型复杂度指标,利用给w加权值,弱化了训练数据的噪声

一般不会正则化b。

2、matplotlib.pyplot

3、搭建模块化的神经网络八股:

前向传播就是搭建网络,设计网络结构(forward.py)

def forward(x,regularizer): #regularizer是正则化权重 w= b= y= return y def get_weight(shape,regularizer): w=tf.Variable()#给w赋初值 tf.add_to_collection("losses",tf.contrib.layers.12_regularizer(regularizer)(w)) return w def get_bias(sahpe): b=tf.Variable() return b

反向传播就是训练网络,优化网络参数(backward.py)

def backward(): x = tf.placeholder() y_ = tf.placeholder() y = forward.forward(x,REGULARIZER) global_step=tf.Variable(0,trainable=False) loss =

正则化

指数衰减学习率

滑动平均

4、三个模块

生成数据集 generateds.py

前向传播 forward.py

反向传播 backward.py

原文:https://www.cnblogs.com/h694879357/p/12292913.html