CDH 5.12.0 默认spark使用1.6.0,虽然spark 1.6.0支持DataFrame,但显得有点版本过旧。需要在cdh 5.12中使用spark 2.X版本,网上搜索了一圈,基本都是都是通过parcels方式进行安装,官方也推荐这种方式。本人比较懒,所以就想Apache spark原生版本是否直接支持CDH呢?经过测试完美支持。简单记录一下步骤:

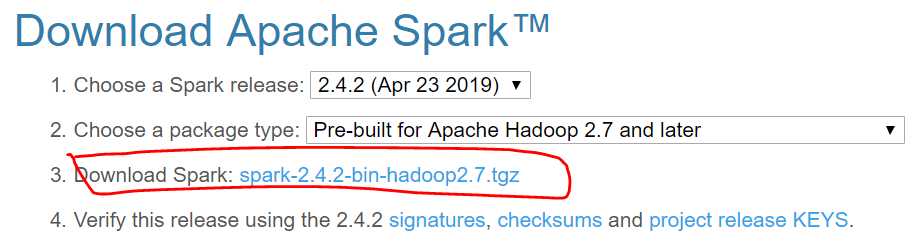

1、下载原生apache spark 2.4.2版本,直接解压即可。

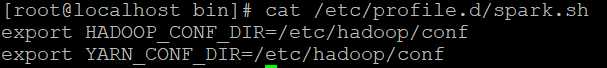

2、设置环境变量HADOOP_CONF_DIR和YARN_CONF_DIR,建议在/etc/profile.d/目录下创建文件,如spark.sh。source /etc/profile.d/spark.sh直接生效。

3、为了支持对hive进行读写,复制hive-site.xml到conf目录。cd /etc/hive/conf/hive-site.xml /usr/local/spark-2.4.2/conf/。

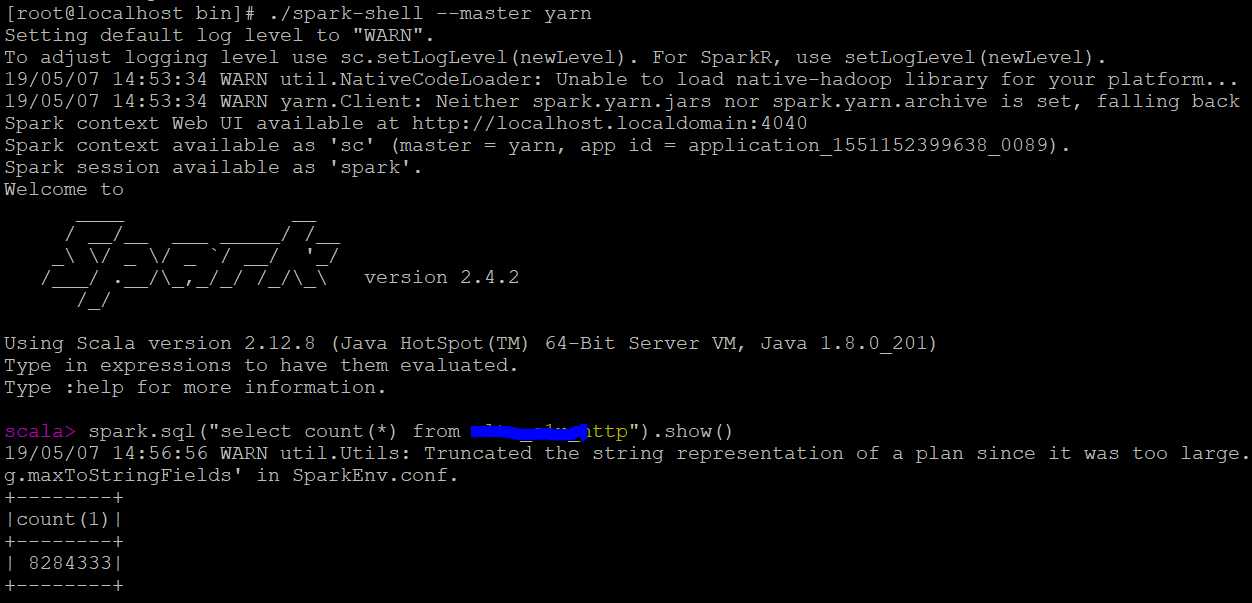

4、验证是否成功执行。

原文:https://www.cnblogs.com/zzhuang/p/10825542.html