一、概述

1.基本工作原理:存在一个带有标签的样本集,即我们知道样本中的每个数据与所属分类的对应关系。输入没有标签的数据,将新数据的每个特征与样本中数据的对应特征进行比较,算法提取最相似样本的分来标签。选择样本数据集中前k个最相似的数据,这就是k-近邻算法中k的出处,通常k是不大于20的整数。最后,选择k个最相似数据中出现次数最多的分类,作为新数据的分类。

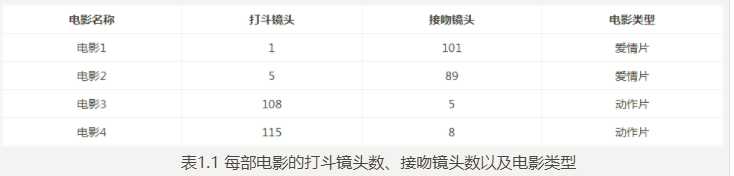

例如上表训练样本集。这个数据集有两个特征,即打斗镜头数和接吻镜头数。分类标签为爱情片和动作片。大致可以观察发现接吻镜头多的是爱情片,打斗镜头多的是动作片。而k-近邻算法可以做到,你告诉它这个电影打斗镜头数为2,接吻镜头数为102,它会依据数据经验告诉你这个是爱情片。但是依据样本数据集k-近邻算法的眼里,电影类型只有爱情片和动作片,它会提取样本集中特征最相似数据(最邻近)的分类标签,得到的结果可能是爱情片,也可能是动作片,但绝不会是"爱情动作片"。当然,这些取决于数据集的大小以及最近邻的判断标准等因素。

2.距离计算

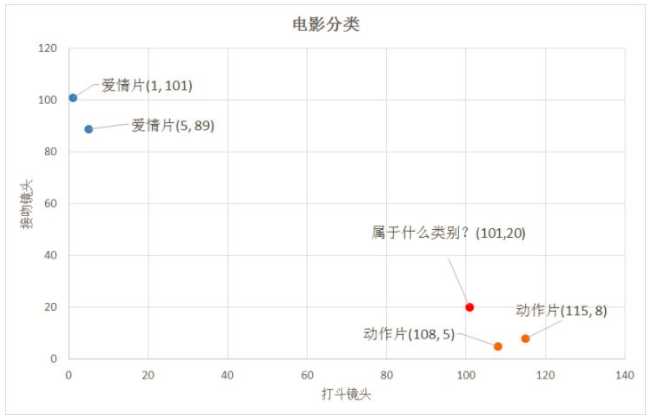

我们可以从散点图大致推断,这个红色圆点标记的电影可能属于动作片,因为距离已知的那两个动作片的圆点更近。k-近邻算法用什么方法进行判断呢?没错,就是距离度量。这个电影分类的例子有2个特征,也就是在2维实数向量空间,可以使用我们高中学过的两点距离公式计算距离,即

通过计算,我们可以得到如下结果:

通过计算可知,红色圆点标记的电影到动作片 (108,5)的距离最近,为16.55。如果算法直接根据这个结果,判断该红色圆点标记的电影为动作片,这个算法就是最近邻算法,而非k-近邻算法。

k-近邻算法步骤如下:

比如,现在我这个k值取3,那么在电影例子中,按距离依次排序的三个点分别是动作片(108,5)、动作片(115,8)、爱情片(5,89)。在这三个点中,动作片出现的频率为三分之二,爱情片出现的频率为三分之一,所以该红色圆点标记的电影为动作片。这个判别过程就是k-近邻算法。

但是,电影例子中的特征是2维的,这样的距离度量可以用两点距离公式计算,但是如果是更高维的呢?我们可以用欧氏距离(也称欧几里德度量),我们高中所学的两点距离公式就是欧氏距离在二维空间上的公式,也就是欧氏距离的n的值为2的情况。

应该还有其他计算距离的方法,待补充.....切比雪夫距离、马氏距离 巴氏距离等

二、算法

k-近邻算法

三、使用

上面学习了简单的k-近邻算法的实现方法,但是这并不是完整的k-近邻算法流程,k-近邻算法的一般流程:

1.收集数据:可以使用爬虫进行数据的收集,也可以使用第三方提供的免费或收费的数据。一般来讲,数据放在txt文本文件中,按照一定的格式进行存储,便于解析及处理。

2.准备数据:使用Python解析、预处理数据。

3.分析数据:可以使用很多方法对数据进行分析,例如使用Matplotlib将数据可视化。

4.测试算法:计算错误率。

5.使用算法:错误率在可接受范围内,就可以运行k-近邻算法进行分类。

6.代码实现:待补充

四、参数

KNeighborsClassifier(n_neighbors=5, weights=’uniform’, algorithm=’auto’, leaf_size=30, p=2, metric=’minkowski’, metric_params=None, n_jobs=None, **kwargs)

KNneighborsClassifier参数说明:

五、特别之处

优点

缺点

参考资料:

1.机器学习实战教程(一):K-近邻算法(史诗级干货长文) | Jack Cui

2.《机器学习实战》。

3.《统计学习方法 李航》。

原文:https://www.cnblogs.com/2019-02-11/p/10597131.html