这种运行模式和"Spark自带Cluster Manager的Standalone Client模式(集群)"还是有很大的区别的。使用如下命令执行应用程序(前提是已经启动了spark的Master、Worker守护进程)不用启动Hadoop服务,除非你用到了HDFS的内容。

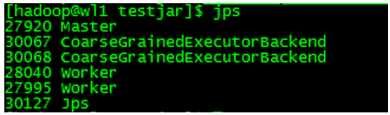

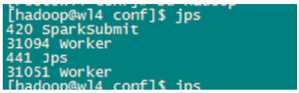

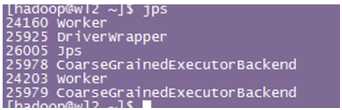

各节点启动的JVM进程情况如下:

master节点上的进程

提交应用程序的客户端上的进程

某worker节点上的进程

客户端的SparkSubmit进程会在应用程序提交给集群之后就退出(区别1)

Master会在集群中选择一个Worker进程生成一个子进程DriverWrapper来启动driver程序(区别2)

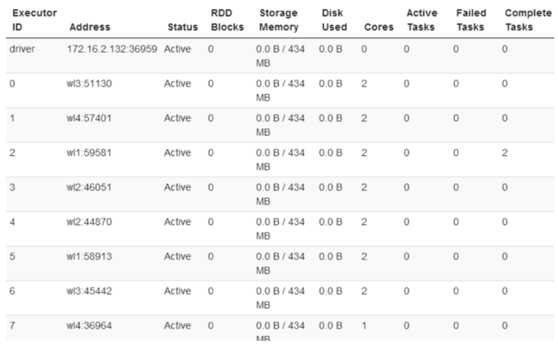

而该DriverWrapper 进程会占用Worker进程的一个core,所以同样的资源下配置下,会比第3种运行模式,少用1个core来参与计算(观察下图executor id 7的core数)(区别3)

应用程序的结果,会在执行driver程序的节点的stdout中输出,而不是打印在屏幕上(区别4)

转载自:

作者:俺是亮哥

链接:https://www.jianshu.com/p/65a3476757a5

來源:简书

Spark运行模式_spark自带cluster manager的standalone cluster模式(集群)

原文:https://www.cnblogs.com/chengzipg/p/9316962.html